Javier Salas

En los últimos días se ha desatado una polémica porque Facebook utilizó a 700.000 personas para un estudio sobre contagio de emociones en la red. La controversia por este estudio, que no es novedoso, podría acabar con el equipo científico de la empresa y con el conocimiento académico de sus investigaciones

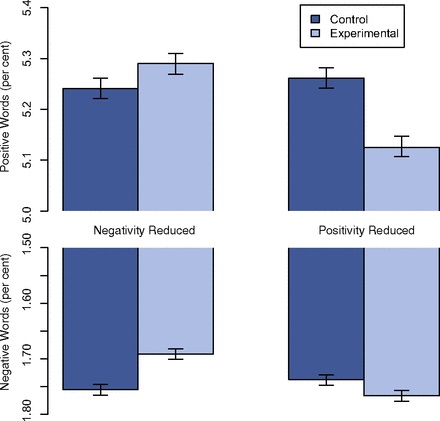

Entre el 11 y el 18 de enero de 2012, los muros de casi 700.000 usuarios de Facebook fueron manipulados: sin previo aviso, se redujo la probabilidad de que vieran publicaciones positivas o negativas realizadas por sus amigos (de habla inglesa). Como resultado, los usuarios estudiados cambiaron su conducta: los que vieron menos publicaciones positivas, usaron palabras más pesimistas al cabo de una semana y viceversa, los que vieron menos negatividad en sus muros fueron algo más positivos. ”Publicaron como promedio una palabra emocional menos, de cada mil palabras publicadas, a lo largo de la semana siguiente”, explica Adam Kramer, del grupo de científicos de Facebook, que realizó este experimento junto con investigadores de las universidades norteamericanas de Cornell y California en San Francisco.

El estudio se publicó en la red el 2 de junio, en la revista científica PNAS, señalando que las emociones son contagiosas también en las redes sociales, como ya se había demostrado anteriormente en entornos físicos. Sin embargo, en la última semana, un terremoto de indignación ha sacudido los cimientos de Menlo Park, donde Mark Zuckerberg tiene su cuartel general. Varias semanas después de hacerse público el estudio, medios y ciudadanos se han soliviantado al descubrir como algo inaudito dos ejes del estudio: “manipular” y “emociones”. A partir de ese momento, las reacciones se han multiplicado hasta el extremo: por ejemplo, que Facebook podría haber “matado” a alguien depresivo al manipular sus sentimientos y que habría que auditarles “como a una especie de Doctor Mengele” de la red.

Tal es el ruido generado, que las agencias de protección de datos de Irlanda y Reino Unido han anunciado que examinarán si se ha producido alguna ilegalidad porque no está claro si los términos de uso le permitían hacerlo. Sheryl Sandberg, directora ejecutiva de la empresa, dijo que estaban arrepentidos y que lamentaba haber enfadado a sus usuarios. El responsable de las políticas de la empresa en Europa, Richard Allan, aseguró:”Queremos hacerlo mejor en el futuro y estamos mejorando nuestro trabajo a partir de estos comentarios”. Kramer, el investigador de Facebook responsable del estudio, ha tenido que pedir disculpas públicamente.

Facebook manipula a diario a sus usuarios sin consentimiento directo y ya ha publicado otros estudios similares

Toda esta polémica puede terminar con un único chivo expiatorio: el equipo de data scientists que fundó en 2007 Cameron Marlow y que estaba permitiendo realizar importantes estudios sobre el comportamiento de las personas en entornos digitales, un conocimiento decisivo en el momento que vivimos. Facebook es una empresa, tiene clientes y cotiza en bolsa, y lo último que le gusta es que se les asocie con la idea de malévolos experimentos de ingeniería social. El runrún de que el grupo científico de Facebook desaparezca o deje de publicar resultados debería preocuparnos.

“Si toda esta polémica sirve para que haya mayor transparencia y más cuidado con estos experimentos, bienvenida sea; si con esto Facebook cierra su grupo científico y no volvemos a saber nada de ellos, sería la peor noticia de todas”, asegura Esteban Moro, especialista en análisis de big data en el campo de las ciencias sociales. Moro, sorprendido con la polémica, tuvo conocimiento del experimento trabajando con gente de este equipo y pensó que se trataba de “un estudio más” de los muchos que esta y otras redes sociales realizan para conocer el comportamiento de sus usuarios y, como suelen justificar, “ayudar a mejorar la experiencia”.

El grupo científico, en riesgo

“Las conclusiones del experimento en realidad no son muy reseñables, los cambios que obtienen son muy pequeños y además son cosas que ya se sabían. El problema aquí es la intervención, modificar el comportamiento de las personas estudiadas”, destaca Moro, investigador de la Universidad Carlos III. “Como investigadores, forma parte de nuestra deontología contar con el consentimiento informado de las personas cuando lo hacemos en un trabajo científico, pero esto es una plataforma privada”, señala.

“La peor noticia sería que Facebook cierre su grupo científico y deje de compartir sus datos con investigadores”, lamenta Moro

Los investigadores no avisaron a las 689.003 cobayas humanas (el 0,04% de los usuarios de Facebook, 1 de cada 2.500) de que se reduciría la probabilidad de que en su muro de aparecieran de forma natural contenidos con palabras positivas (en unos casos) y negativas (en otros). Al cabo de una semana, la gente que vio menos publicaciones positivas escribió un 0,1% menos palabras positivas en sus mensajes. De forma similar, el otro grupo publicó un 0,07% menos palabras negativas. Como señala Kramer en sus disculpas, querían comprobar si es cierto el tópico de que nos deprime ver lo felices que son las vidas de nuestros amigos: resultó que, si provoca alguna emoción, es justo la contraria.

En marzo de este mismo año, otro grupo mixto de Facebook y científicos sociales llegó a las mismas conclusiones en un estudio que analizaba cómo influía la lluvia en las emociones volcadas en la red —nos entristece— y cómo estas publicaciones se contagiaban a los amigos que vivían en lugares más soleados en ese momento. En este estudio publicado por PLoS ONE, en el que también participó Kramer, se estudiaron millones de usuarios, todos los que viven en las 100 principales ciudades de EEUU, durante tres años. No hubo críticas, pero tampoco se manipuló a las cobayas.

No es la primera vez ni será la última

Sí se las manipuló, y se las sigue manipulando, en los procesos electorales. En 2010, Facebook fue capaz de movilizar a 340.000 abstencionistas para que fueran a votar en las legislativas de EEUU: sin consultarles previamente, la red hizo aparecer en el muro de 61 millones de norteamericanos un botón que animaba a votar, mostrando a los amigos que ya lo habían hecho. Es decir, manipuló a millones de personas, sin avisarlas, para que acudieran a las urnas, aumentando un 0,14% la participación electoral de un país como EEUU. Nadie se escandalizó cuando Nature publicó este experimento en 2012.

“Sorprende la reacción en este caso y que nadie dijera nada entonces. Se entiende que animar a la gente a votar es algo bueno y crearles sentimientos negativos no lo es”, resume Moro, quien trabajó en San Diego con varios de los firmantes de estos dos últimos estudios, como James Fowler y Nicholas Christakis. ”Para mí es fascinante que todo el mundo esté abalanzándose contra este estudio cuando es algo que ya hemos hecho”, asegura Fowler.

Algo que ya han hecho y que siguen haciendo. Como ha declarado Andrew Ledvina, que formó parte del equipo de científicos de Facebook durante año y medio. ”No hay proceso de revisión per se. Cualquier persona en ese equipo puede poner en marcha una prueba. Siempre están tratando de alterar el comportamiento de las personas”, asegura Ledvina en el Wall Street Journal, que informa de que este año son medio centenar las personas dedicadas a estos trabajos. Los estudios científicos de Facebook suelen publicarse con acceso abierto, sin las restricciones habituales de las revistas de impacto.

¿De verdad se manipularon emociones?

Mientras sus científicos sean de alto nivel, y no tengan miedo a compartir sus hallazgos, otros investigadores, los medios y la ciudadanía sabrán algo de lo que están cocinando en Menlo Park. “El debate es bueno, pero sólo surge cuando hacen públicos sus resultados. Si todo este ruido provoca que Facebook deje de publicar estudios no beneficiará a nadie”, lamenta Moro. Hace dos años se aplaudía desde las páginas de Nature las posibilidades que esta apuesta por la ciencia ofrecían al mundo de la investigación académica. Nunca nadie tuvo tal cantidad de información válida sobre la sociedad contemporánea: cuando ponen parte de ese conocimiento en manos de investigadores de las mejores universidades, al menos, puede ser de utilidad al resto de la sociedad.

De cada 1.500 publicaciones que debería ver un usuario, Facebook solo le muestra 300. Hay un cribado permanente

Por otro lado, como ha señalado el experto en salud mental John Grohol, no está en absoluto claro que el experimento afectara realmente a las emociones de los usuarios. Estos trabajos se centran en herramientas que presuponen sentimientos en determinadas palabras y oraciones, no es un estudio sobre las emociones de las personas. “Llegan a sus conclusiones analizando el lenguaje de pequeñas piezas de texto. Las actualizaciones de estado de Facebook rara vez tienen más de unas pocas frases. Los investigadores no miden realmente el estado de ánimo de nadie”.

Como reconoce el propio Kramer, “el impacto real sobre las personas del experimento era el mínimo para detectarlo estadísticamente”. Y en el peor de los casos, si de algo sirve la manipulación de cientos de miles de usuarios en este experimento es para evitarle sentimientos negativos a los demás 1.300 millones, como vino a defender Monika Bickert, responsable de políticas públicas de la compañía. Desde luego, Facebook prefiere tenernos contentos en su portal para que pasemos cuanto más tiempo mejor interactuando todo lo posible.

Somos cobayas humanas

Cada vez que un usuario accede a su página de Facebook, hay un promedio de 1.500 publicaciones esperando a ser vistas. Pero la red no las muestra todas: las criba hasta dejarlas en apenas 300. Las publicaciones de ONG en Facebook han pasado de mostrarse al 20% de sus seguidores a solo un 1% o 2%, para fomentar las campañas de pago. Es un cribado que se realiza permanentemente, entre las 2.500 millones de publicaciones que se realizan a diario, en función de algoritmos que premian innumerables valores y que, como resultado final, buscan el beneficio de la empresa. “Es una plataforma privada, con gastos e intereses, y el producto eres tú”, zanja el investigador de la Carlos III.

Lo mismo sucede con otras plataformas de internet, como Google, que tiene un conocimiento tan o más exhaustivo de sus usuarios y que realiza nada menos que 20.000 experimentos de este tipo cada año. Evidentemente, no pide permiso, salvo en los términos y condiciones de uso que todo el mundo acepta pero que nunca nadie lee. Y un simple cambio en su motor de búsqueda podría manipular decisiva e inadvertidamente resultados electorales, como asegura este estudio. Por no hablar de la publicidad que se cuela en nuestras vidas a diario tratando de alterar nuestra conducta. En los centros comerciales, absolutamente todo, desde la música a la luz están pensados para manipularnos emocionalmente para fomentar el consumo. “Pero con Facebook siempre llueve sobre mojado”, resume Moro.

REFERENCIA

'Experimental evidence of massive-scale emotional contagion through social networks' doi:10.1073/pnas.1320040111